特斯拉没能解决3年前的问题,现在另一个人死了

2016年5月7日,一辆开启Autopilot的特斯拉Model S,在佛罗里达的高速公路上和前方横向穿越的拖车相撞,40岁的驾驶员Joshua Brown当场死亡。

2019年5月17日,同样在佛罗里达州的一条高速公路上,50岁的Jeremy Banner也遭到了类似惨案:他的Model 3与一辆前方横向行驶的拖车相撞,整个车顶直接被掀掉。

把两场车祸摆在桌面上来看,之间存在着巨大的差异。

它们虽然都叫Autopilot,但版本隔了三年之久,Brown的Models S基于以色列公司Mobileye提供的技术,他的去世,间接导致了两家公司在2016年分道扬镳,2017年,Mobileye被英特尔用153亿美元的天价收购。

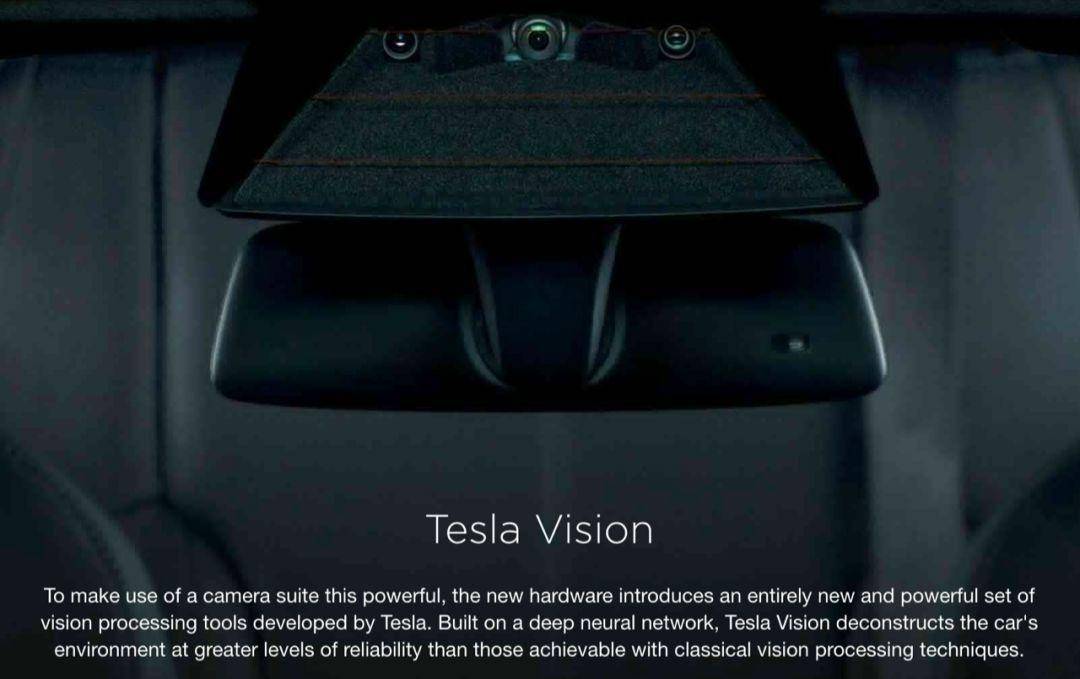

此后特斯拉自主开发了第二代Autopilot系统,Banner的Model 3搭载的就是最新版。

在Autopilot 2.0系统中,车辆上搭载了3个前置摄像头、4个侧方摄像头和、一个后置摄像头、一个毫米波雷达、12个超声波雷达、英伟达定制Drive PX2计算平台。

特斯拉声称这套硬件系统理论上支持“完全的自动驾驶”,会通过OTA软件更新来不断完善功能。但3年后的“历史重演”不禁让人疑问,特斯拉大肆宣传的车辆自动驾驶能力,到底靠不靠谱?

一起事故,特斯拉用了3年还没解决

Brown的事故有其特殊性,特斯拉后来给出的官方解释是:“在强烈的日照条件下,驾驶员和自动驾驶都未能注意到拖挂车的白色车身,因此未能及时启动刹车系统。”

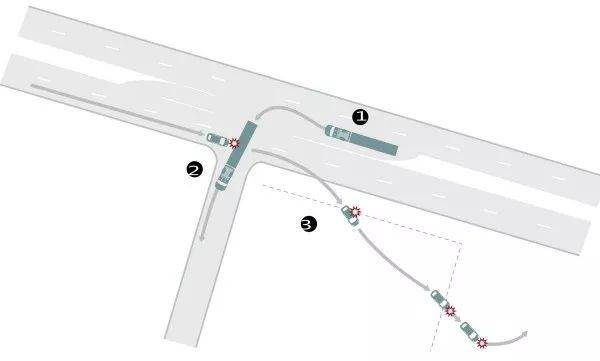

事故演示图

类似的不寻常的情况,在自动驾驶领域被称为“Corner Case”或“Edge Case”。按情理来讲,特斯拉在重新设计系统时,完全有机会去解决过去发生过的Corner Case。但至少从结果上来看,它做的非常糟糕。

特斯拉采用了雷达和摄像头相配合的自动驾驶方案。雷达擅长检测移动物体而非静止物体,当一辆车不在本车辆的行进方向时(比如前方横穿的车辆),它也很难监测出来。雷达的输出信号有的时候会被系统忽略,比如它可能将立交桥判定成障碍物,导致车辆急刹车。所以,在这些情况下,就要用摄像头输出的算法来检测垂直于车辆方向的卡车,或者立交桥这种静止物体。

但特斯拉摄像头的算法并不完美。

一个叫green匿名工程师声称自己破解了一辆Model X,并把Autopilot后台运算的视频放在youtube上,就在今年的3月14日,他在Twitter上曝光了一个问题。他的特斯拉一开始检测到了前方的拖车,但后来green发现,在几秒钟内的画面内,由于拖车下的大空间,Autopilot没有ID出它是一辆拖车,而把它判定当成了一个可以穿越的物体,并明确汇出了绿色的可行驶区域,和黄色的驾驶预测线,如果不是人为干预,车辆很可能会从拖车底下穿过去。

这么大的安全隐患,为什么特斯拉在3年内没有修复,为什么监管部门没有做充分的调查,让恶性事件再次发生?

政策上的姑息容忍,让特斯拉无所畏惧

在第一起事故中,美国国家公路交通安全管理局(NHTSA)认为,Brown有责任为自己的驾驶行为负责,最后判定特斯拉无罪。而后特斯拉只是做了道歉,对自动驾驶系统做了微调,去掉了官网上“自动驾驶”的字眼,但系统一直开放。

后来特斯拉在Autopilot的免责声明中明确指出,在驾驶员开启Autopilot后,必须时刻把双手放在方向盘上,并随时准备接管汽车。

而在Banner的事件中,国家交通安全委员会(NTSB)的调查显示,Banner在碰撞前约10秒钟使用了Autopilot,“从碰撞前不到8秒到撞击时,车辆没有检测到驾驶员的方向盘上的手。”在一份声明中,特斯拉的一位发言人用不同的方式表达了这一点,将被动的“车辆没有检测到驾驶员的方向盘上的手”,更改为更加主动的的“驾驶员立即将手从方向盘上移开。”

表述上的差别,是特斯拉想强调驾驶员没有按照规则使用Autopilot,把责任推到驾驶员一方。

NTSB的初步报告给了特斯拉逃脱的借口,如果特斯拉再次赢得豁免权也不奇怪,在过去几次严重的车祸中,特斯拉都没有得到严重的惩罚。

2018年6月,一辆开启Autopilot的Model X撞向高速护栏

美国政府对于自动驾驶表现出了前所未有的支持和容忍。哪怕在很多市民态度鲜明地反对在城市内测试的无人车,哪怕Uber无人车将行人直接撞死后,政府都没有责令企业停止无人车的研究。这种容忍也让特斯拉更加激进和无所畏惧。

在过去,特斯拉CEO埃隆马斯克(Elon Musk)在类似事件的态度上一向强硬,反复表示问题并不总是特斯拉的,去年马斯克说:“当发生严重事故时,几乎总是用户的过度自满,开了Autopilot就不看路,这种做法是不对的。”

特斯拉官方也一口咬定Autopilot的安全性,在声明中指出,在美国,所有制造商的车辆平均行驶8600万英里就会出现一起致命事故,而备有Autopilot的特斯拉,平均每行驶3.2亿英里,才会有一起死亡事故。

公司早先还发布了一份关于Autopilot安全性的季度安全报告,但该报告缺乏细节,行内专家表示报告里没有核心数据可以让他们把Autopilot和其它自动驾驶系统做对比。只有特斯拉对Autopilot的运作逻辑和源代码有100%的理解,并且把它们作为商业秘密严加看守。

越来越多的声音要求特斯拉做出更详尽的信息披露,来帮助消费者来判断Autopilot的可靠性,特斯拉则丝毫不理会外界的质疑,依然在按部就班地推进Autopilot,并表示要在2020年部署自动驾驶出租车队。

在Autopilot完全证明自己之前,它不配不上消费者的信任

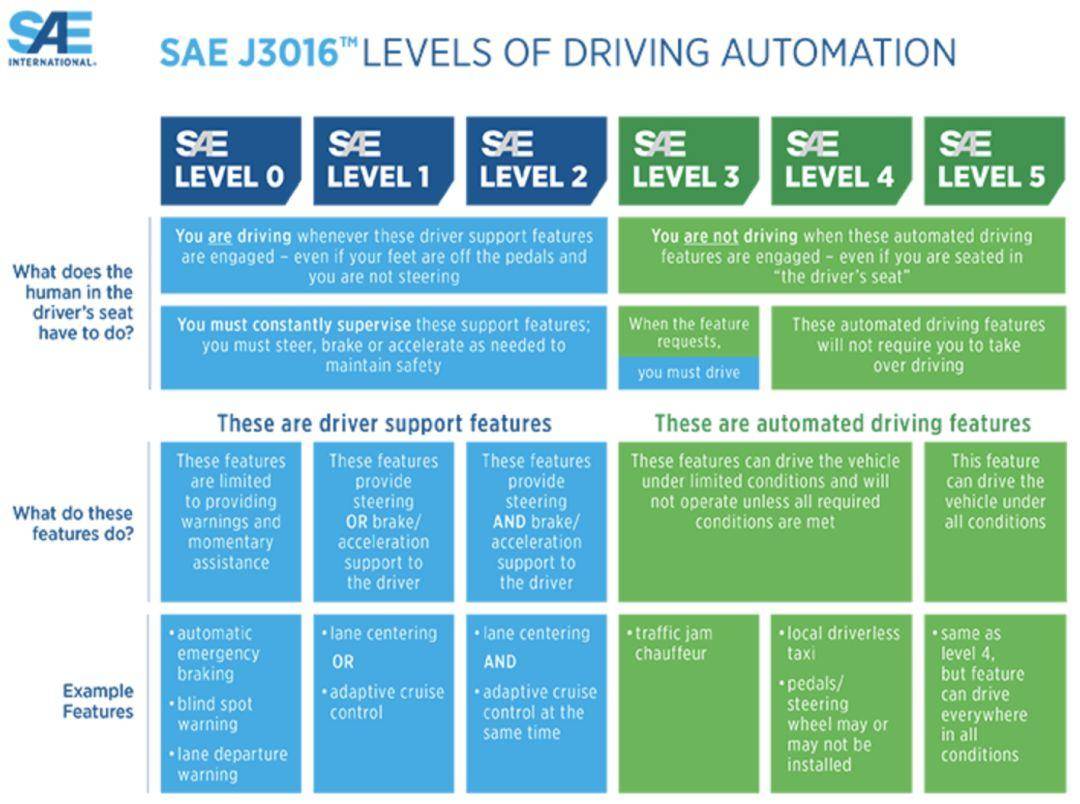

目前的Autopilot结合了自适应巡航,车道保持,自动停车以及自动改变车道的能力。但无论特斯拉怎么吹嘘,在美国汽车工程师协会的定义下,Autopilot属于低等级(Level 2)的辅助驾驶系统。

它能实现的功能非常有限,而且这些有限功能的完成度不高,在多个版本中都出现了系统Bug。

国内知名车评媒体“38号车评”对Autopilot的6条总结是:

- 距离完全的自动驾驶有非常非常非常遥远的距离

- 仅可以在道路条件非常好,而且连贯的道路使用(比如高速)

- 高度依赖车道线和照明条件

- 并不比其它车厂的L2辅助驾驶系统好用

- 当Autopilot无所适从时,给驾驶员留下的反应时间非常有限

- 在车道合流和车道分岔的情况下表现尤其糟糕

综合各方媒体和Autopilot以往的表现(从2016年5月至今,有数十起Autopilot致死案例),我们并不建议用户现在去花钱购买Autopilot,它所带来的功能更多的是一种新鲜的体验,如果过度依赖,将大大提高车辆发生危险的概率。

那么Autopilot的未来值得期许么?

在世界上百家车企和制造商中,特斯拉是极少数坚持使用视觉方案为主的公司,但从工程的角度来看,摄像头有先天的局限,比如在夜间、光线快速变化(隧道)、暴雨、雪天等路况下,摄像头的感知能力会急剧下降。

多传感器方案,尤其是激光雷达的加入可以弥补摄像头的不足,而马斯克却放出豪言,表示“只有傻子才用激光雷达,赌注激光雷达的公司注定完蛋”,再次把Autopilot推到风口浪尖。

无论如何,特斯拉都将继续在争议中前行,2019年4月22日,特斯拉发布了Autopilot 3.0,其中搭载了特斯拉自研芯片,号称算力比2.0内置的英伟达Drive PX2高21倍,马斯克号称要在2019年推送完备的自动驾驶功能...

或许最终特斯拉能推出值得信任的Autopilot,但它一定是建立在淋漓的鲜血之上的,不知道在马斯克看来,这是不是在自动驾驶的光荣变革之路上,不可避免的伟大牺牲。

NEXTTECH

NEXTTECH